Notre travail

Une vue d'ensemble du type de travail que nous effectuons et de tous nos projets actuels et passés.

Domaines de travail

Nos domaines de travail

Nous travaillons sur des projets dans plusieurs domaines distincts :

Politique

Nous menons des actions de plaidoyer aux États-Unis, dans l'Union Européenne et aux Nations Unies.

Notre travail politique

Futurs

Nous travaillons sur des projets visant à guider l'humanité vers les résultats bénéfiques rendus possibles par les technologies de transformation.

Nos travaux sur l'avenir

Sensibilisation

Nous élaborons du matériel pédagogique destiné à éclairer le discours public et à encourager les gens à s'impliquer.

Notre travail de sensibilisation

Octroi de subventions

Nous accordons des subventions à des personnes et à des organisations, qui travaillent sur des projets qui soutiennent notre mission.

Nos programmes de subventions

Évènements

Nous réunissons les responsables des domaines concernés pour discuter des moyens de garantir la sécurité du développement et de l'utilisation de technologies puissantes.

Nos évènements

Nos réalisations

Nos contributions les plus importantes

Voici quelques-unes des réalisations dont nous sommes les plus fiers :

Organisation des premières conférences sur la sécurité de l'IA

Nous avons été les premiers à réunir des personnalités de premier plan dans le domaine de l'IA pour discuter de nos préoccupations concernant les risques liés à la sécurité de cette technologie émergente.

Voir nos événements

Création du premier programme de subventions pour la sécurité de l'IA

De 2015 à 2017, nous avons organisé le tout premier programme de subventions destiné à financer des projets de sécurité de l'IA. Nous offrons actuellement de nombreuses possibilités de subventions pour des projets qui font avancer notre mission.

Voir nos subventions

Élaboration des principes d'Asilomar en matière d'IA

En 2017, le FLI a coordonné l'élaboration des principes d'IA d'Asilomar, l'un des premiers ensembles de principes de gouvernance de l'IA et l'un des plus influents.

Voir les principes

Les Future of Life Awards récompensent 18 héros méconnus

Chaque année depuis 2017, le Future of Life Award récompense les personnes qui ont contribué à aider à préserver les conditions de vie.

Voir l'Award

Production d'une série de vidéos de sensibilisation sur les armes autonomes létales.

Nous avons produit deux courts métrages décrivant un monde, dans lequel la prolifération des armes autonomes a été autorisée.

Regardez les vidéos

Recommandation sur l'IA dans la feuille de route des Nations Unies sur la coopération numérique

Nos recommandations (3C) sur la gouvernance mondiale des technologies de l'IA ont été adoptées dans la feuille de route concernant la coopération numérique du secrétaire général des Nations Unies.

Voir la feuille de route

Projets

Les projets sur lesquels nous travaillons

Voici un aperçu de tous les projets sur lesquels nous travaillons actuellement :

Lutter contre les "deepfakes

2024 se transforme rapidement en l'année du "Fake" (faux). Dans le cadre d'une coalition croissante d'organisations concernées, le FLI appelle les législateurs à prendre des mesures significatives pour perturber la chaîne d'approvisionnement des "deepfakes" générés par l'IA.

Sommets sur la sécurité de l'IA

Les gouvernements coopèrent de plus en plus pour assurer la sécurité de l'IA. Le FLI soutient et encourage ces efforts.

Concours créatif sur la superintelligence

Le concours du meilleur matériel de formation créatif sur la superintelligence, les risques associés, ainsi que sur les répercussions de cette technologie dans notre monde. 5 prix de 10 000 $ chacun.

Élaboration de règles possibles en matière d'IA pour les États-Unis

Notre équipe chargée de la politique américaine conseille les responsables politiques du Congrès et des États sur la manière de garantir que les systèmes d'IA sont sûrs et bénéfiques.

S'engager en faveur du décret sur l'IA

Nous apportons une contribution formelle aux agences du gouvernement fédéral américain, y compris une expertise technique et politique sur de nombreuses questions, telles que les contrôles à l'exportation, la gouvernance du matériel, la définition de normes, les marchés publics, etc.

Perspectives des religions traditionnelles sur l'avenir positif de l'IA

La majorité de la population mondiale pratique une religion traditionnelle. Pourtant, les perspectives de ces religions sont largement absentes des discussions stratégiques sur l'IA. Cette initiative vise à aider les groupes religieux à exprimer leurs préoccupations et leurs espoirs relatifs à leur foi dans un monde avec l'IA. Elle vise également à coopérer avec eux pour éviter les préjudices et bénéficier des avantages de l'IA.

La lettre des sages sur les menaces existentielles

Les sages, le Future of Life Institute et de nombreuses personnalités éminentes appellent les dirigeants du monde à s'attaquer d'urgence aux dommages et aux risques croissants de la crise du climat, des pandémies, des armes nucléaires et de l'IA non gouvernée.

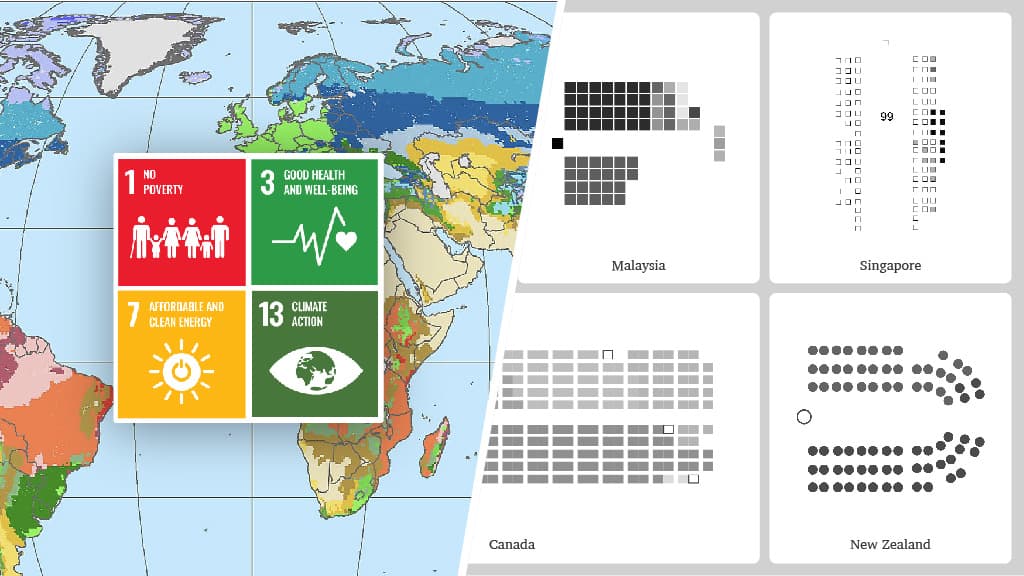

Réaliser des avenirs prometteurs - Nouvelles possibilités de subventions du FLI

Nous ouvrons deux nouvelles possibilités de financement pour soutenir la recherche sur les façons dont l'intelligence artificielle peut être exploitée en toute sécurité pour rendre le monde meilleur.

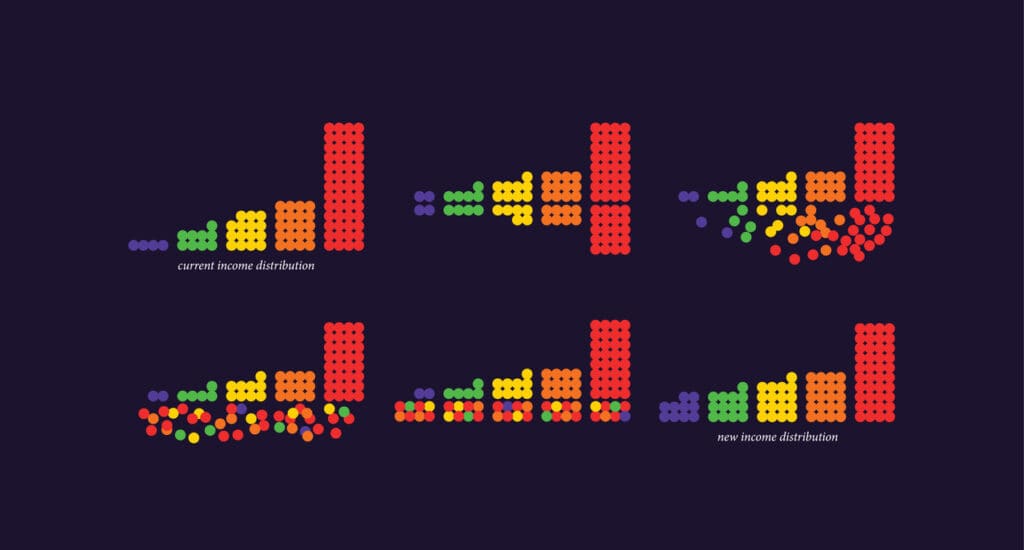

Le Windfall Trust

Le "Windfall Trust" est une initiative ambitieuse visant à rechercher et à mettre en place une institution internationale fiable, qui pourrait fournir des ressources de base universelles, dans le cas d'une opportunité générée par les progrès de l'IA.

Convergence de l'IA : risques à la croisée de l'IA et des menaces nucléaires, biologiques et cybernétiques

Le caractère à double tranchant des systèmes d'IA peut amplifier celui d'autres technologies - c'est ce que l'on appelle la convergence de l'IA. Nous fournissons une expertise politique aux décideurs américains dans trois domaines essentiels de convergence : biologique, nucléaire et cybernétique.

Renforcement du règlement européen sur l'IA

Nos principales recommandations consistent à élargir le champ d'application de la loi pour réglementer les systèmes à usage général et elles visent à étendre la définition de la manipulation interdite à tout type de technique de manipulation, ainsi qu'à la manipulation qui cause un préjudice à la société.

Podcast Imagine A World

Pouvez-vous imaginer un monde en 2045, où nous parviendrions à éviter la crise climatique, les guerres majeures et les effets néfastes de l'intelligence artificielle ? Notre nouvelle série de podcasts explore les moyens de construire un avenir plus positif et propose des idées intéressantes sur la manière d'y parvenir.

Sensibilisation aux armes autonomes létales

Les applications militaires de l'IA se développent rapidement. Nous élaborons des documents pédagogiques sur la manière dont certaines catégories restreintes d'armes utilisant l'IA peuvent nuire à la sécurité nationale et déstabiliser la civilisation, notamment les armes dans lesquelles la décision de tuer est entièrement déléguée à des algorithmes.

L'escalade artificielle

Notre film de science-fiction montre un monde, où l'intelligence artificielle (IA) est intégrée aux systèmes de commandement, de contrôle et de communication des armes nucléaires ("NC3"), avec des résultats terrifiants.

Gouvernance mondiale de l'IA à l'ONU

Notre participation aux travaux des Nations Unies s'étend sur plusieurs années et comprend plusieurs initiatives, y compris la feuille de route pour la coopération numérique et le pacte mondial pour le numérique (GDC).

Concours de construction d'univers

Le Future of Life Institute a accepté les candidatures d'équipes venant du monde entier pour participer à un concours doté d'un prix allant jusqu'à 100 000 $. L'objectif est de concevoir des visions d'un avenir plausible et ambitieux, qui inclut fortement l'intelligence artificielle.

Future of Life Award

Chaque année, le Future of Life Award est décerné à un ou plusieurs héros méconnus qui ont contribué de manière significative à préserver l'avenir de la vie.

Future of Life Institute Podcast

Un podcast consacré à des entretiens avec certains des plus grands intellectuels et acteurs mondiaux dans le domaine des technologies émergentes et de la réduction des risques. Plus de 140 épisodes depuis 2015, 4,8/5 étoiles sur Apple Podcasts.

Pages liées

Cherchiez-vous autre chose ?

Voici quelques autres pages que vous avez peut-être cherchées :

Notre mission

Découvrez notre mission et nos principes fondamentaux.

Agir

Quel que soit votre niveau d'expérience ou d'ancienneté, il y a quelque chose que vous pouvez faire pour nous aider à garantir que l'avenir de la vie soit positif.

Travail sur les évènements

Nous réunissons les responsables des domaines concernés pour discuter des moyens de garantir la sécurité du développement et de l'utilisation de technologies puissantes.